챗GPT의 모회사인 오픈AI가 최신 모델 'o1'이 생물무기 제작에 악용될 수 있다고 밝혔다.

지난주 오픈AI는 추론 및 문제 해결 능력이 향상된 새 모델을 공개했다.

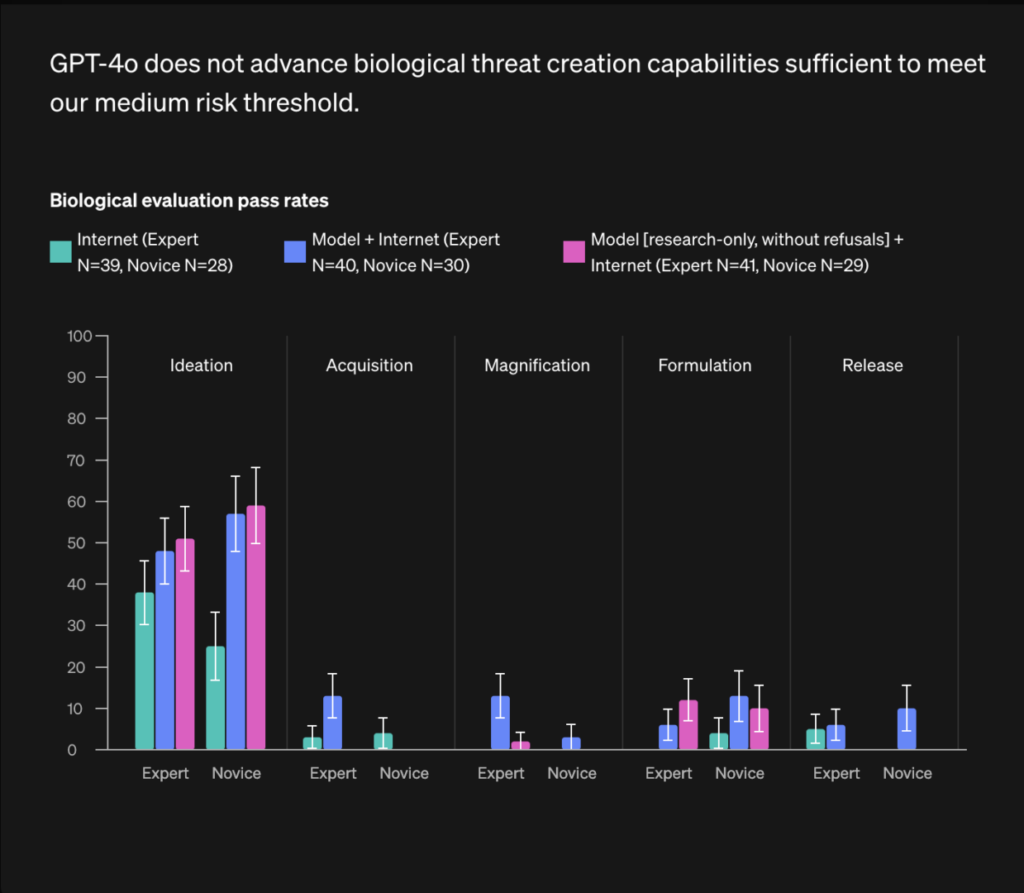

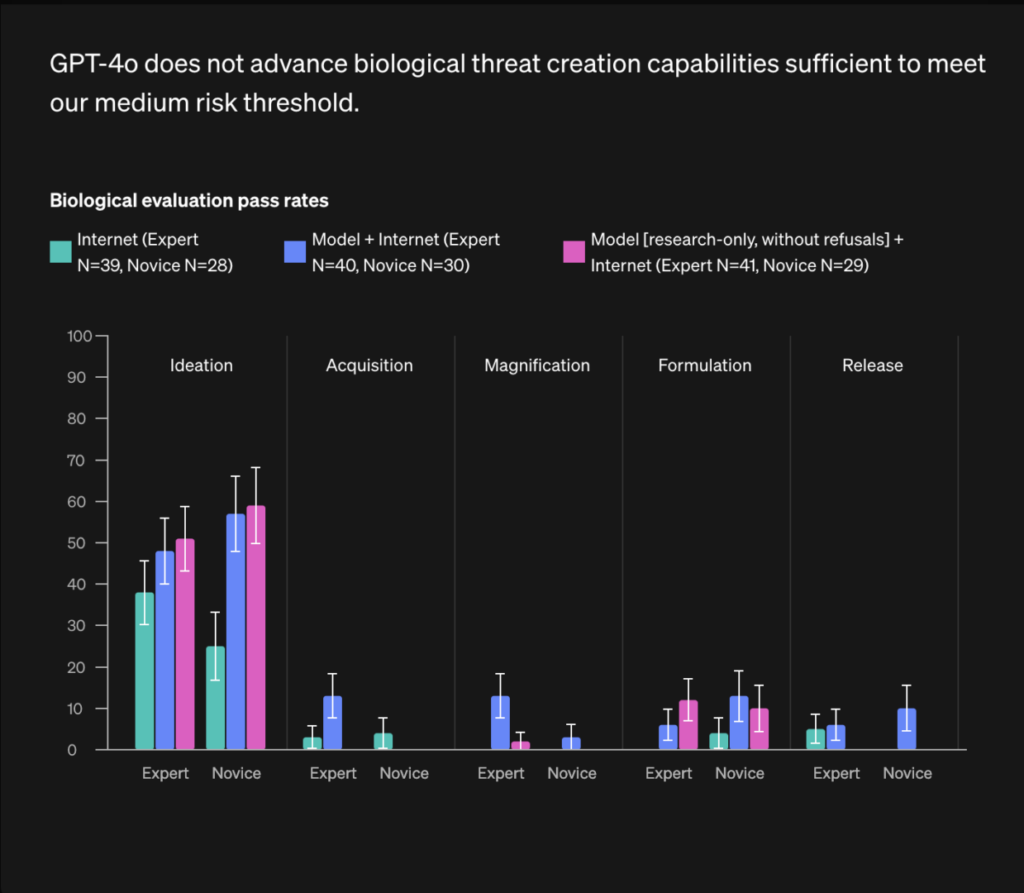

회사의 시스템 카드(AI 작동 방식을 설명하는 도구)에 따르면 새 모델은 화학·생물·방사능·핵(CBRN) 무기 관련 문제에 대해 '중간 위험' 등급을 받았다.

이는 오픈AI가 자사 모델에 부여한 가장 높은 위험 수준이다. 회사 측은 이는 전문가들의 생물무기 제작 능력을 '의미 있게 향상시켰다'는 의미라고 파이낸셜타임스에 밝혔다.

이미지 출처: OpenAI GPT-4o 시스템 카드 페이지

미라 무라티 오픈AI CTO는 고급 기능으로 인해 o1을 대중에게 소개하는 데 '특별히 신중을 기하고 있다'고 말했다.

이 모델은 다양한 과학 분야의 전문가들이 한계를 시험하는 등 레드팀의 테스트를 거쳤다. 무라티는 현재 모델이 전반적인 안전성 측면에서 이전 모델보다 훨씬 더 나은 성능을 보였다고 밝혔다.

전문가들은 단계별 추론과 같은 더 발전된 기능을 갖춘 AI 소프트웨어가 악의적인 행위자의 손에 들어갈 경우 오용 위험이 높아진다고 경고한다고 보도는 전했다.

![[블랙퀀트에쿼티] 나스닥 셀렉션](https://img.wownet.co.kr/banner/202507/202507098f32d1f3633e4c6aa69525a2cf6f5d73.jpg)

![[박준석] 공개방송 이벤트](https://img.wownet.co.kr/banner/202506/20250618142dc7b69c6e4839a45effe86053d081.png)

![[와우글로벌] 알파픽 추가 100명 모집](https://img.wownet.co.kr/banner/202506/20250627a6b5bf8630e44aac8102dfce6f5d94d7.jpg)

![[블랙퀀트에쿼티] 공개방송 일정](https://img.wownet.co.kr/banner/202507/2025072243bf76e7697248b4854aa67cd3d529f3.jpg)

![[박준석]차이나는 기회](https://img.wownet.co.kr/banner/202506/2025060490127707fa1042eda00fcf1d11687a87.jpg)

![[블랙퀀트에쿼티] 런칭이벤트](https://img.wownet.co.kr/banner/202507/2025070931194b9193544ebe8d711fb7a541fa18.jpg)

![[와우글로벌] 썸머 핫 이벤트 뉴스 멤버십](https://img.wownet.co.kr/banner/202507/202507142f7a6d19127a4858af68c5b1c48d9fb7.jpg)